無謀な行動の問題点

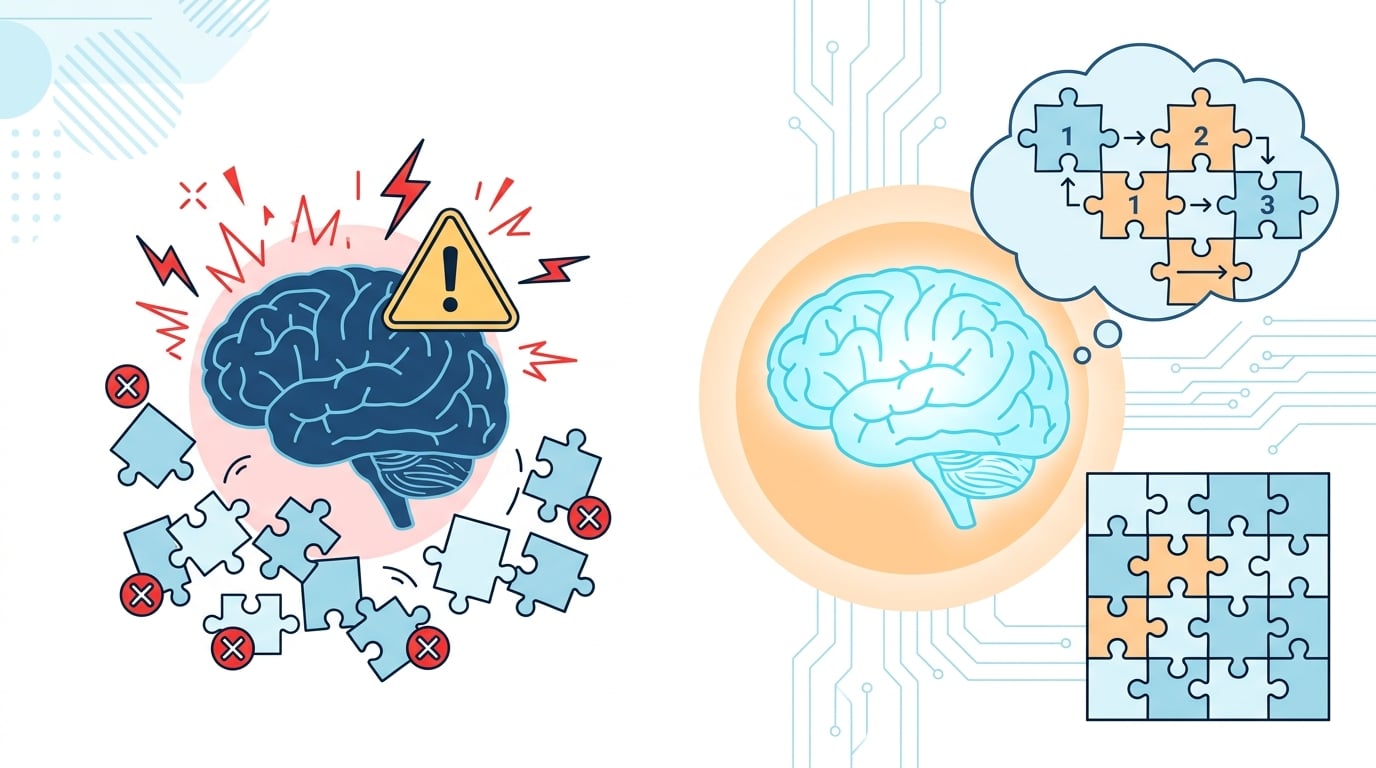

複雑な論理問題を解く、または複数の情報を取得する際、AIに即座に『行動』を選択させようとするのは、深刻な誤りを招く原因になります。

人がジグソーパズルを解く様子を考えてみてください:

- 彼らはランダムにピースを選び、ボードに押し込むわけではありません。

- 頭の中で、あるいは言葉で戦略を立てます: 「まず、外枠用の平らな端のピースを見つけ、次にこの青いピースが合うか見てみよう。」

同様に、もし私たちがAIに ただ 『行動』のみ出力させる(推論フェーズを飛ばす)ように指示すると、それは『無謀な行動』と言えます。推論の前に答えられる前提条件を整理していないため、しばしば予測ミスや幻覚、あるいはまったく不適切なツールを選んでしまうのです。

声に出して考える

言語モデルはトークン単位で論理を構築します。AIに『声に出して考える』(問題を分析するテキストを生成する)ように強制することで 行動を取る その前に、正しい論理的結論に至るための必要な作業スペースを提供できます。